スティーブ・ロー氏(写真提供:朝日新聞社)日々驚くべき進歩を遂げるテック業界。スティーブ・ロー氏はニューヨーク・タイムズの記者として、ChatGPTの開発者であるサム・アルトマン氏や、ツイッター買収などでも話題をさらうイーロン・マスク氏など、テック業界の中心人物への取材を行ってきた。氏が考える「AI最大のリスク」とは? この記事では『人類の終着点 戦争、AI、ヒューマニティの未来』(朝日新書)に収録されたロー氏の分析を公開する。

スティーブ・ロー氏(写真提供:朝日新聞社)日々驚くべき進歩を遂げるテック業界。スティーブ・ロー氏はニューヨーク・タイムズの記者として、ChatGPTの開発者であるサム・アルトマン氏や、ツイッター買収などでも話題をさらうイーロン・マスク氏など、テック業界の中心人物への取材を行ってきた。氏が考える「AI最大のリスク」とは? この記事では『人類の終着点 戦争、AI、ヒューマニティの未来』(朝日新書)に収録されたロー氏の分析を公開する。AIが抱える最大のリスクはいったい何か?

――AI技術が社会や人間にどう影響するか見極めるには時間がかかると言いますが、では、現時点での最大のリスクはいったい何でしょうか。

それは「テクノロジーが社会の先を行ってしまうこと」です。今、私たちが行っているのは、人類に対する制御不能な実験です。だから、われわれ人間が、いろいろな場面で機械の指示に従おうとしている。

欧州では、リスクに基づく規制管理レベルを定めるなど、AIに対する幅広いアプローチを行っています。「雇用や融資、刑事司法といったリスクの高い分野においても、AIに仕事を任せてよいものか?」「AIにローンを組ませることはできるのか?」「AIを刑務所に送り込むことができるのか?」。今挙げたようなハイリスクの分野では、規制をかけるべきでしょう。また、AIシステムが出した結論があなたに不利だった場合には、「どんな方法でその結論に至ったのか」を知る必要もあるでしょう。

そして、こうした大まかなガイドラインを示すことはもちろん難しいのですが、それを実施するのはさらに難しいのです。しかし、それでも方法はあります。

たとえばアメリカには「雇用法」や「公正融資法」といった法律もありますし、雇用機会均等委員会という組織もあります。AIテクノロジーが創り出す新たな状況に合わせて改善する必要はあります。しかし、制度的構造は整っています。こうした問題は必ずしも新しいものではありません。医療も金融もすでに厳しく規制されています。

生成AIが質的に違うのかどうか。OpenAIのサム・アルトマンCEOやテスラのイーロン・マスクCEOは、「本当に恐ろしい」と言っています。「人類存続の危機になり得る」と。いささか大げさですよね。

ただ一つ言えるのは、人々の政府に対する関心を高めたということです。何もせず放置するのは危険です。そのリスクへの対処方法を政府が示せるのかどうかに関心が向かっています。

この先どうなってゆくのかわかりません。それでも、インターネットを見れば、少し想像がつきます。良いこともたくさんありましたし、革新的なこともありました。その一方で、悪いこともたくさんありましたよね。偽情報やいじめ、民主主義を脅かすことなど。

つまり、良いことも悪いこともたくさんあります。だから、いずれ何かしらの規制がかかるかもしれません。

現時点では、生成AIの波に乗っている人々がやろうとしているのは、「他の人より少し先を行くこと」でしかありません。つまり、まだ私たちは、暴走列車に乗っているというわけではないのです。

進化し続ける技術に「規制」をかけることはできるか?

――アメリカ政府や議会のこれまでを見ていると、「ハイテク産業に新たな規制をかける」という点で、良い実績をあげられていません。一方で、米中間の情勢を見る限り、アメリカは中国と競争をしなければなりません。まさに「ハイテク覇権競争」です。こうした情勢の中で、アクセルとブレーキを同時に踏むようなハイテク規制はうまくいくのでしょうか。

まさにあなたがおっしゃる通りです。たしかに、アメリカ国内でも意見が分かれています。「規制をかけて進歩のスピードを遅らせるべきかどうか」。そして「中国との競争を続けるべきかどうか」「競争はどうやって続ければよいのか」と。

政府も社会も「利害のバランス」を取ろうとします。ただし、立法的なアプローチはとても難しいです。

もしかすると、国内の半導体産業を支援するCHIPS法のような方法であれば、可能性はあるかもしれません。議会は完全に行き詰まり、何をやってもダメな状況ですが、CHIPS法は超党派で合意して成立しました。

その背景に中国の脅威があったことは確かです。しかし、われわれは中国のようにはやらないでしょう。なぜなら、監視国家などは望んでいないからです。民間企業は、政府による監視など望んでいないのです。しかしその一方で、「競争」は望んでいます。

「ガードレールつきのイノベーション」が望ましいですが、どうなるかはまだこれからです。

――Signal Foundationの会長で元グーグル社員であるメレディス・ウィテカーさんは、データと計算能力が大手IT企業に集中することに懸念を示しています。新しい生成AIテクノロジーや、私たちが進む方向について上がっている懸念の声に対して、あなたはどうお考えですか。

AIの台頭についての懸念は、以前からありました。AIには、データの収集と蓄積が必要不可欠であり、膨大な計算能力が求められるからです。ウィテカーさんが危機感を抱いているような「研究とイノベーションをどこまで民営化するのか」という点に関しても、学識経験者は以前から懸念を表明していました。こうした問題への提案も出ています。たとえば、アレン人工知能研究所は最近、巨大なデータベースを公開しました。

現状は独占と言うより「寡占」

大規模言語モデルを構築しているIT大手に対しては、独占禁止法違反やデータ集中の懸念がこの数年ずっと存在してきました。「生成AIの誕生によって、データや権力の集中はさらに進むのだろうか?」などの疑問が起きるのは当然のことです。

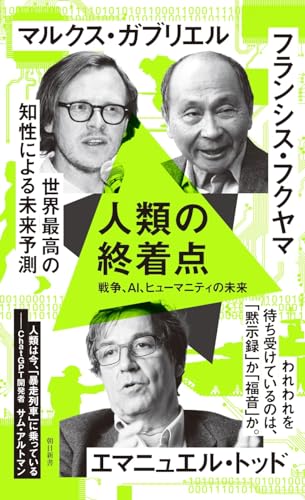

『人類の終着点 戦争、AI、ヒューマニティの未来 』(朝日新書)。書影をクリックするとAmazonのサイトにジャンプします

『人類の終着点 戦争、AI、ヒューマニティの未来 』(朝日新書)。書影をクリックするとAmazonのサイトにジャンプします中には、対抗策を取ろうとする動きも出ています。分散型のデータベース技術であるブロックチェーンや暗号資産、そしてオープンソースAIの構築です。これがどこまで発展するかについては、まだよくわかっていません。

ただ、集中ではなく分散へと向かう流れもあります。先ほど挙げたアレン人工知能研究所などもその流れの中にいます。果たして彼らが行うことは、不可能なのでしょうか。見極めるには時間がかかるでしょう。

とはいえ歴史を振り返ると、こうしたことはオープンソースの分野で、以前からありました。少し専門的な技術の話になってしまいますが、パソコンやサーバーには「Linux」というオープンソースのオペレーティングシステム(OS)が入っています。このOSが台頭したことで、マイクロソフトのウィンドウズは市場力を奪われました。

そこでマイクロソフトが打ち出したのは、「クラウドへの移行」という別の方法です。これにより、マイクロソフトは売上を伸ばしたのです。つまり、ここで行われたのは、規制を求めるということではなく、「技術力による対抗」でした。

また、データの集中などの問題は、当然ながら、今後も取り組んでいくべきものです。たとえば、米グーグルも「反トラスト法」(独占禁止法)違反で提訴されました。

では、「生成AIの時代には、もっと大きな問題が起きるのか?」という疑問もあるかもしれません。マイクロソフトやグーグルといった大手IT企業が争っているので心配はいらない、と言ったところで、あまり慰めにはならないでしょう。

正確に言うと、現状は鉄道時代と似ています。つまり、独占と言うより「寡占」なのです。大手IT企業数社はお互いに対抗する力を持っている。そこにはいくらかの真実もありますが、この分野における市場集中を懸念する人たちにとって、こんなことを言ったところで慰めにはならないでしょう。

鄭重声明:本文の著作権は原作者に帰属します。記事の転載は情報の伝達のみを目的としており、投資の助言を構成するものではありません。もし侵害行為があれば、すぐにご連絡ください。修正または削除いたします。ありがとうございます。